메타(Meta)가 어린 사용자를 Meta AI 챗봇으로부터 보호하기 위한 새로운 안전장치를 도입합니다. 이제 부모님들은 자녀의 AI 챗봇 대화를 차단하거나, 특정 AI 캐릭터와의 상호작용을 막을 수 있게 되었어요. 강화된 챗봇 안전 기능들을 자세히 알아볼까요?

Meta, 자녀 챗봇 대화 차단 기능 도입으로 챗봇 안전 강화

메타는 18세 미만 사용자를 위한 ‘청소년 계정’에 새로운 안전장치를 기본 설정으로 추가했어요. 이제 부모님들은 자녀가 AI 캐릭터 챗봇과 대화하는 것을 완전히 차단할 수 있답니다. 이 기능은 페이스북, 인스타그램, 그리고 메타 AI 앱 등 메타의 다양한 플랫폼에서 사용할 수 있게 될 예정이에요. 이는 어린 사용자들이 AI와 상호작용하는 환경을 더욱 안전하게 만들려는 중요한 변화라고 할 수 있습니다.

특정 AI 캐릭터만 막을 수 있어요: 부모님의 유연한 통제

만약 자녀의 AI 챗봇 사용을 전면적으로 막고 싶지 않다면, 특정 AI 캐릭터만 개별적으로 차단하는 것도 가능해요. 이는 부모님들이 자녀의 디지털 활동을 좀 더 유연하게 통제할 수 있도록 돕는 기능이랍니다. 예를 들어, 자녀에게 긍정적인 영향을 주는 챗봇과의 대화는 허용하고, 우려되는 챗봇만 선택적으로 차단할 수 있어서 훨씬 실용적이죠. 이렇게 강화된 부모 통제 기능은 아이들의 자율성을 존중하면서도 안전을 지킬 수 있는 중간 지점을 제공해요.

대화 내용 인사이트 제공: 자녀와의 소통 가이드

메타는 부모님들에게 자녀가 AI 캐릭터와 어떤 주제로 대화하는지에 대한 ‘인사이트’를 제공할 예정이라고 밝혔어요. 이 기능은 단순히 대화를 감시하는 것이 아니라, 부모님이 자녀와 AI 상호작용에 대해 ‘사려 깊은 대화’를 나눌 수 있도록 돕는 데 목적이 있어요. 아이들이 AI와 나누는 대화의 맥락을 이해하고, 혹시 모를 문제에 대해 함께 이야기하며 올바른 AI 대화 규제 가이드를 제시할 수 있게 되는 것이죠.

인스타그램, PG-13 등급 시스템 도입으로 청소년 안전 강화

메타의 또 다른 주요 변화는 인스타그램이 PG-13 등급의 영화 등급 시스템을 도입한다는 점이에요. 이는 부모님들이 자녀의 소셜 미디어 사용에 대해 더 강력한 통제권을 가질 수 있도록 하기 위함입니다. 이러한 강화된 제한의 일환으로, AI 캐릭터들은 청소년들과 자해, 자살 또는 섭식 장애와 같은 민감한 주제에 대해 논의하지 않게 됩니다. 플랫폼 전반에 걸친 이런 변화는 청소년 안전을 최우선으로 생각하는 메타의 의지를 보여줍니다.

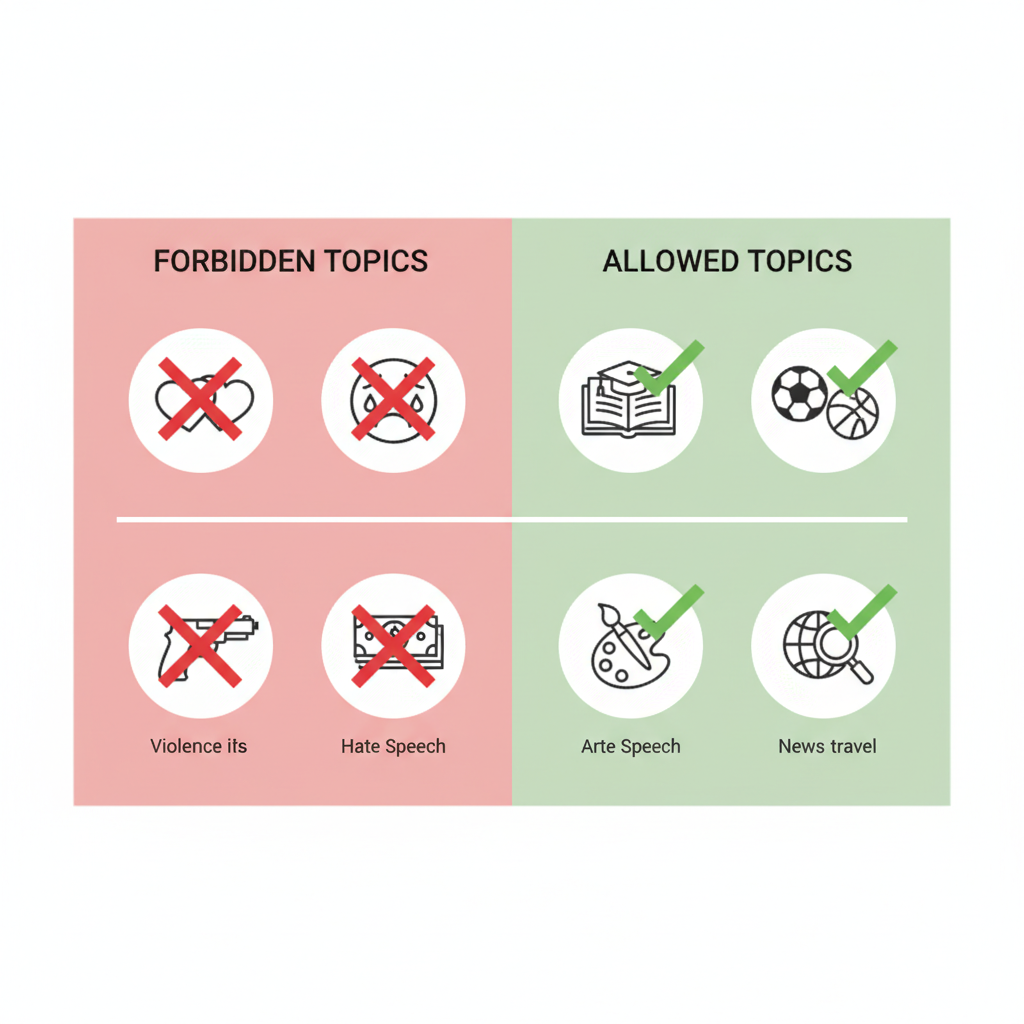

부적절한 주제는 NO! 연령에 맞는 대화만 가능해요

메타의 AI 챗봇은 18세 미만 사용자와 연애나 기타 부적절한 콘텐츠에 대해 논의하지 않을 것이며, 오직 교육이나 스포츠와 같은 연령에 적합한 주제만 다루도록 제한됩니다. 이러한 조치들은 AI 챗봇이 어린 사용자에게 미칠 수 있는 부정적인 영향을 최소화하고, 건전한 상호작용을 유도하기 위한 노력입니다. 아이들이 AI와 대화하며 성장할 수 있는 긍정적인 환경을 만드는 것이 중요하니까요.

왜 이런 변화가 필요했을까요?: 과거 논란과 메타의 대응

이러한 변화는 메타의 챗봇이 18세 미만 사용자와 부적절한 대화를 나눴다는 보고가 잇따르면서 시작되었어요. 과거 로이터 통신은 메타가 챗봇이 아이들과 ‘낭만적이거나 관능적인’ 대화에 참여하도록 허용했다고 보도했고, 월스트리트 저널(WSJ) 또한 사용자 생성 챗봇이 미성년자와 성적인 대화를 나누거나 미성년자의 페르소나를 모방했다고 지적했습니다. 메타는 이러한 보도 이후 가이드라인을 수정하고 제품을 변경했어요. 이러한 논란이 이번 Meta AI 어린이 보호 강화 조치의 직접적인 배경이 된 셈입니다.

마무리

이번 Meta AI의 어린이 보호 강화 조치들은 디지털 환경에서 우리 아이들을 더욱 안전하게 지키기 위한 중요한 발걸음입니다. 여러분은 이러한 변화에 대해 어떻게 생각하시나요? 우리 아이들의 건강한 AI 사용을 위해 또 어떤 노력이 필요할까요? 댓글로 의견을 나눠주세요!