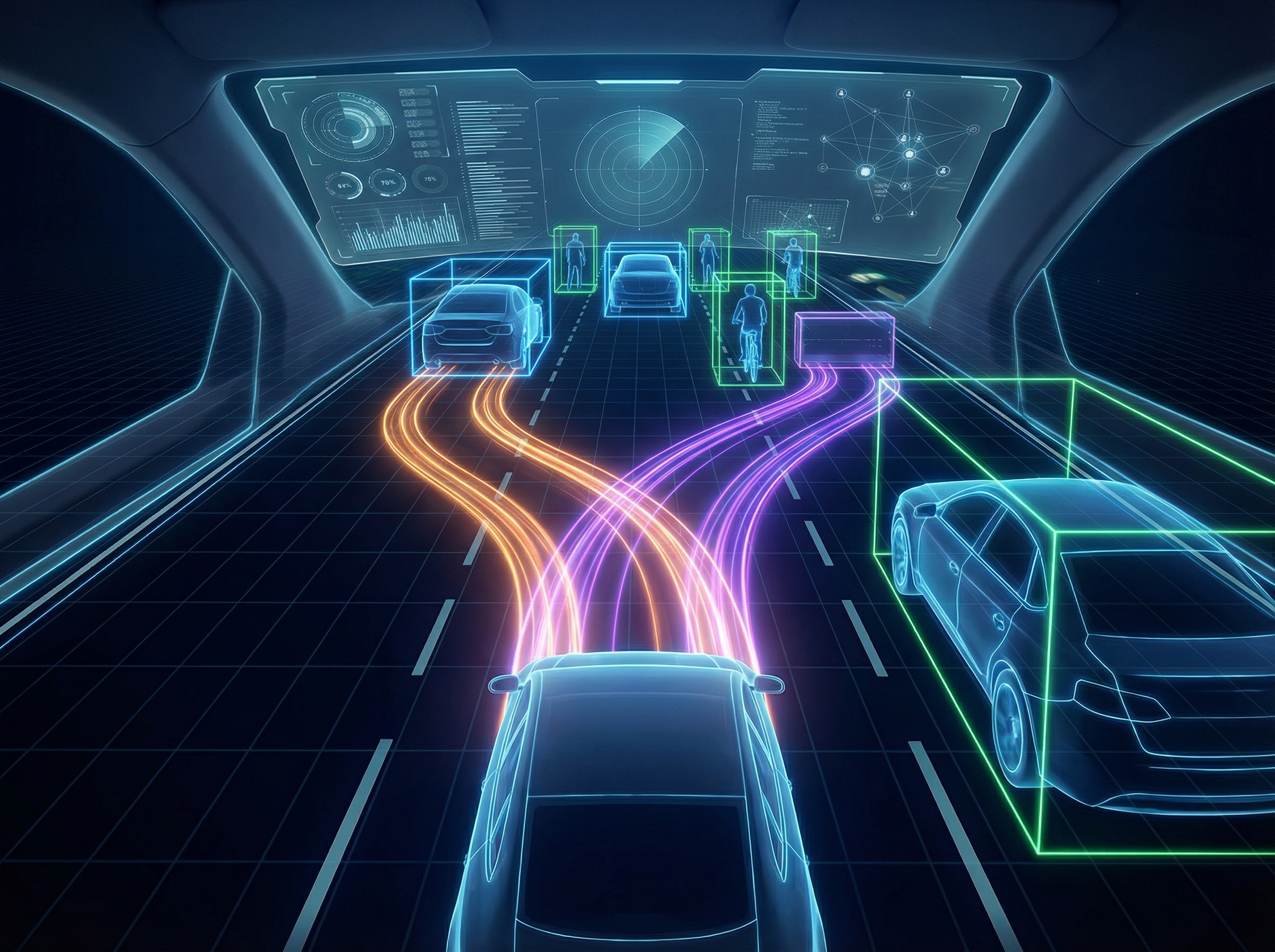

이제 자율주행차가 단순히 정해진 경로를 따라가는 수준을 넘어 사고 현장의 복잡한 상황을 인간처럼 스스로 추론하게 됐어요. CES 2026에서 엔비디아가 발표한 알파마요는 100억 개의 파라미터를 가진 인공지능 모델로 신호등이 고장 난 교차로 같은 돌발 상황에서도 최선의 선택을 내릴 수 있게 도와준답니다.

알마파요 1이 해결하는 자율주행의 고질적인 문제

그동안 자율주행 기술은 학습되지 않은 예외적인 상황인 엣지 케이스에서 한계를 보여왔어요. 하지만 이번에 공개된 엔비디아 알파마요 1 모델은 시각 언어 행동 모델을 기반으로 해서 자동차가 마치 사람처럼 생각하도록 만들어졌더라고요. 100억 개의 파라미터를 가진 이 모델은 단순히 데이터를 암기하는 게 아니라 상황을 논리적으로 분석하는 능력을 갖췄어요.

예를 들어 복잡한 교차로에서 신호등이 꺼져 있거나 경찰이 수신호를 하는 상황처럼 드문 경우에도 당황하지 않고 대처할 수 있게 된 거죠. 문제를 단계별로 쪼개고 모든 가능성을 검토한 뒤에 가장 안전한 경로를 선택하는 방식이라서 훨씬 믿음직스러워요.

인간의 뇌처럼 단계별로 사고하는 체인 오브 서트 기술

엔비디아의 자동차 부문 부사장인 알리 카니는 이번 모델의 핵심이 체인 오브 서트 즉 사고의 사슬 방식이라고 설명했어요. 자동차가 왜 이런 결정을 내렸는지 스스로 설명할 수 있다는 점이 정말 놀랍더라고요. 이전에는 인공지능이 왜 그렇게 움직였는지 알기 어려운 블랙박스 상태였다면 이제는 그 추론 과정을 투명하게 확인할 수 있게 된 거예요.

이런 기술 덕분에 자율주행 시스템은 단순한 기계 장치에서 벗어나 실제 세상을 이해하고 행동하는 피지컬 AI로 진화하게 됐어요. 젠슨 황 CEO도 이 순간을 물리적 AI의 챗GPT 모먼트라고 표현하며 기계가 진짜 세상을 이해하기 시작했다고 강조했답니다.

개발자를 위한 오픈소스 코드와 방대한 드라이빙 데이터셋

엔비디아는 이번에 알파마요의 기본 코드를 허깅페이스에 모두 공개했어요. 덕분에 전 세계의 개발자들이 이 모델을 가져다가 자신의 차량에 맞게 더 작고 빠르게 튜닝하거나 새로운 도구를 만들 수 있게 됐더라고요. 자동 라벨링 시스템을 만들어서 영상 데이터를 태깅하거나 차량의 결정이 올바른지 체크하는 평가 도구로도 활용할 수 있어요.

공개된 1700시간의 실제 주행 데이터

단순히 코드만 준 게 아니라 전 세계 다양한 지역과 환경에서 수집한 1,700시간 이상의 주행 데이터셋도 함께 풀었어요. 여기에는 평소에 보기 힘든 아주 희귀하고 복잡한 실제 주행 시나리오들이 포함되어 있어서 자율주행차를 훈련시키는 데 엄청난 도움이 될 거예요.

가상 세계에서 먼저 달리는 시뮬레이션 프레임워크 알파심

자율주행차를 매번 실제 도로에서만 테스트하기에는 위험도 크고 비용도 많이 들잖아요. 그래서 엔비디아는 알파심이라는 오픈소스 시뮬레이션 프레임워크를 깃허브에 출시했어요. 이 도구는 센서부터 주변 트래픽까지 실제 도로 환경을 그대로 재현해줘서 개발자들이 안전하게 대규모 테스트를 진행할 수 있게 해준답니다.

코스모스 생성형 월드 모델과의 시너지

여기서 주목할 점은 코스모스라는 엔비디아의 생성형 월드 모델이에요. 실제 환경을 가상으로 구현해서 미래를 예측하고 행동을 결정하는 시스템인데 알파마요와 결합하면 실제 데이터와 합성 데이터를 섞어서 훨씬 정교하게 학습을 진행할 수 있더라고요. 가상의 공간에서 수백만 번의 사고 예방 연습을 마친 뒤 도로로 나오니 더 안전할 수밖에 없겠죠.

엔비디아 젠슨 황이 말하는 피지컬 AI의 미래

젠슨 황은 이제 기계가 현실 세계를 이해하고 추론하며 직접 행동하는 시대가 열렸다고 선언했어요. 알파마요는 자율주행차에 추론 능력을 부여해서 아주 드문 시나리오에서도 안전하게 주행하고 자신의 운전 결정을 설명할 수 있게 해줘요. 이건 단순히 운전 편의성을 높이는 수준이 아니라 도로 위의 안전 패러다임을 완전히 바꾸는 일이에요.

피지컬 AI가 고도화될수록 자율주행차뿐만 아니라 물류 로봇이나 제조 현장의 로봇들도 더 똑똑해질 거예요. 엔비디아가 이번에 공개한 오픈소스 모델들은 그런 미래를 앞당기는 기폭제 역할을 톡톡히 할 것으로 보여요.

마무리

엔비디아 알파마요 공개로 자율주행 기술은 이제 새로운 국면에 접어들었어요. 인간처럼 생각하고 판단하는 자동차가 도로 위를 달린다면 운전이 서툰 사람이나 돌발 상황에 대처하기 힘든 환경에서도 훨씬 안전한 이동이 가능해질 거예요. 여러분은 인공지능이 스스로 판단해서 운전하는 차를 믿고 탈 준비가 되셨나요? 앞으로 이 오픈소스 모델들이 얼마나 더 발전해서 우리 삶을 편하게 만들어줄지 정말 기대되네요.

이어서 보면 좋은 글

#엔비디아알파마요 #자율주행차 #CES2026 #피지컬AI #오픈소스AI #젠슨황 #알파심 #코스모스AI #미래기술 #인공지능운전