우리는 흔히 생성형 AI가 내놓는 결과물을 보며 신기해합니다. 하지만 그 화려한 결과물의 밑바닥에는 우리가 미처 알지 못했던 불편한 진실이 숨어 있습니다. 생성형 AI가 왜 자꾸 차별적인 답변을 내놓는지, 그 기원을 파헤쳐 봅니다.

생성형 AI, 도대체 무슨 의미인가

많은 사람들이 인공지능이라는 단어를 혁신적인 기술의 대명사처럼 사용합니다. 하지만 냉정하게 따져보면 이 용어는 1956년 연구 자금을 따내기 위해 만들어진 마케팅 용어에 불과합니다. 단어의 정의부터가 모호한 상태에서 우리는 거대한 기술적 환상에 빠져 있는지도 모릅니다.

유전학이 데이터 학습에 영향을 준 이유

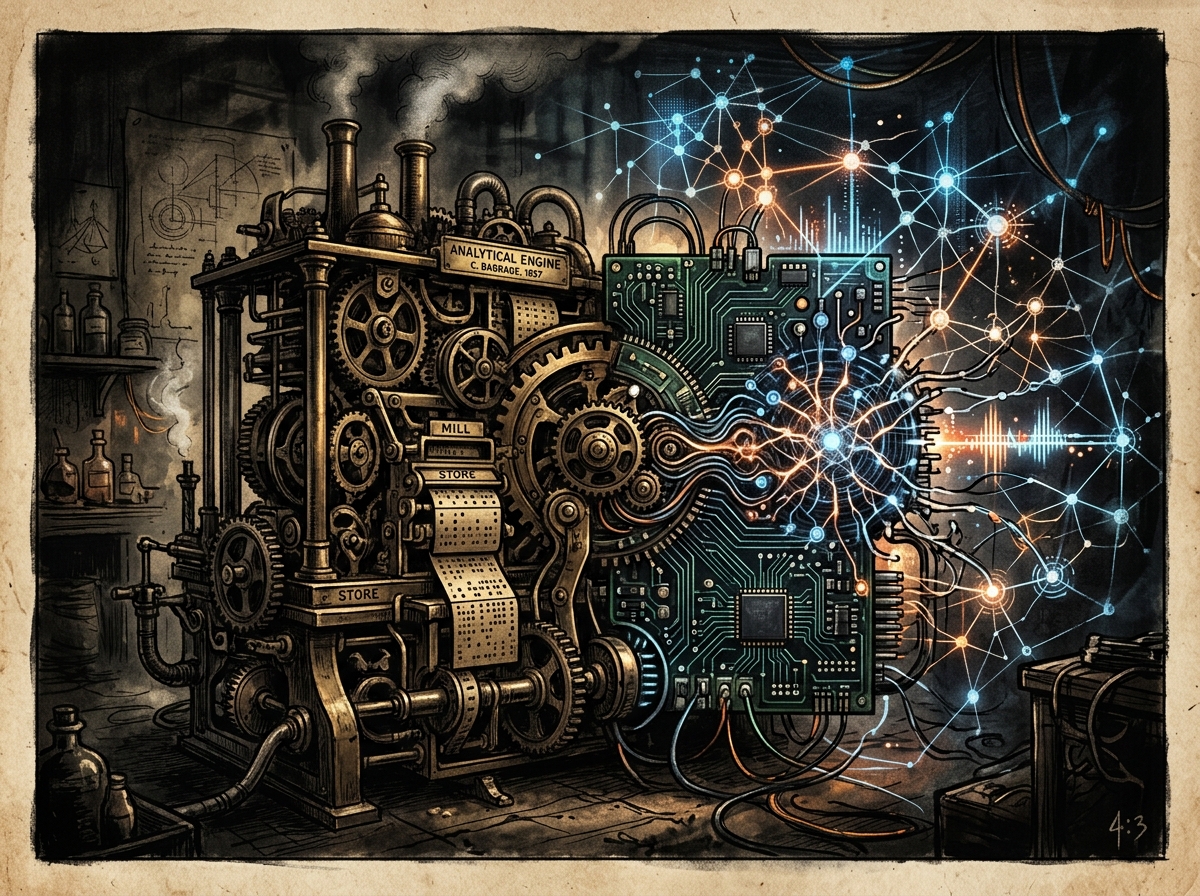

현대 머신러닝의 기초가 되는 통계 기법들 중 상당수는 19세기 빅토리아 시대의 우생학적 배경에서 출발했습니다. 찰스 다윈의 사촌인 프란시스 갈턴은 인류를 등급 매기기 위해 통계적 모델링을 활용했고, 이러한 사고방식은 결과적으로 인간의 지능을 기계처럼 수치화할 수 있다는 믿음을 공고히 했습니다. 우리가 사용하는 AI 모델에 이런 편향된 사고 체계가 녹아 있는 것은 어찌 보면 당연한 결과일지도 모릅니다.

왜 AI는 인종 차별적 결과물을 생성할까

생성형 AI 모델들은 방대한 데이터를 학습하면서 인간 사회의 왜곡된 편견까지 그대로 흡수합니다. 흑인 여성이 이미지를 생성할 때 인공적인 화이트 워싱이 일어나거나, 성적인 편향이 섞인 답변이 튀어나오는 것은 모델이 세상을 인식하는 방식이 이미 특정 집단에 치우쳐 있기 때문입니다.

- 학습 데이터의 원천이 서구 중심적임

- 특정 인종이나 성별에 대한 고정관념이 데이터에 잔존함

- 모델이 ‘정상’의 범주를 좁게 설정하는 경향

기업은 왜 이러한 오류를 방관하는가

감독 기관이나 기업들은 이러한 문제를 ‘일시적인 버그’ 혹은 ‘어쩔 수 없는 기술적 한계’로 치부하곤 합니다. 하지만 실제로는 기술의 기반이 되는 철학적 토대를 수정하기보다, 당장의 상용화와 이윤 창출에 집중하느라 근본적인 문제 해결을 외면하고 있는 것이 현실입니다. 기업 입장에서 윤리적 가치보다 마케팅 효율이 우선시되는 구조가 굳어져 버린 것입니다.

Ghost in the Machine이 말하는 진실

발레리 베치 감독의 다큐멘터리 ‘Ghost in the Machine’은 우리가 맹목적으로 믿고 있는 AI가 사실은 과거의 낡고 차별적인 지식 체계 위에서 구축되었음을 폭로합니다. AI는 객관적인 지능이 아니라, 인간의 편견이 극대화된 거울과도 같습니다. 이 영화는 단순히 기술을 비판하는 것을 넘어, 우리가 어떤 눈으로 기술을 바라봐야 할지 근본적인 질문을 던집니다.

기술적 신화에서 벗어나야 하는 이유

우리가 AI를 대할 때 필요한 태도는 맹목적인 찬사가 아닌 비판적인 관찰입니다. AI가 내놓는 모든 답변이 진리라고 믿지 말고, 그 속에 숨겨진 데이터의 출처와 편향성을 의심해야 합니다.

마무리에 부쳐

기술은 결코 가치 중립적이지 않습니다. 오늘날의 생성형 AI 열풍이 훗날 또 다른 형태의 차별을 낳지 않으려면, 우리는 시스템의 기저에 깔린 역사적 과오를 반드시 인지해야 합니다. 기술을 소비하는 주체로서 우리 스스로가 데이터와 알고리즘의 편향을 경계하는 문화를 만들어 가야 할 때입니다.

출처: https://www.theverge.com/entertainment/897923/ghost-in-the-machine-valerie-veatch-interview

이어서 보면 좋은 글

#인공지능 #생성형AI #데이터편향 #우생학 #알고리즘 #인종차별 #기술윤리 #AI역사 #디지털문해력 #GhostInTheMachine