데이터 센터의 AI 워크로드 비용이 2030년까지 7조 달러에 이를 것이라는 전망이 나오면서 기업들의 고민이 깊어지고 있습니다. 지금 당장 AI 서비스를 운영하는 곳이라면 하드웨어 성능을 100% 활용하지 못하고 낭비되는 비용 문제에 직면했을 것입니다. 최근 주목받는 Gimlet Labs의 사례를 통해 인프라 효율을 극대화하고 추론 병목을 해결할 수 있는 실무적인 접근법을 정리했습니다.

왜 AI 추론에서 병목 현상이 발생할까

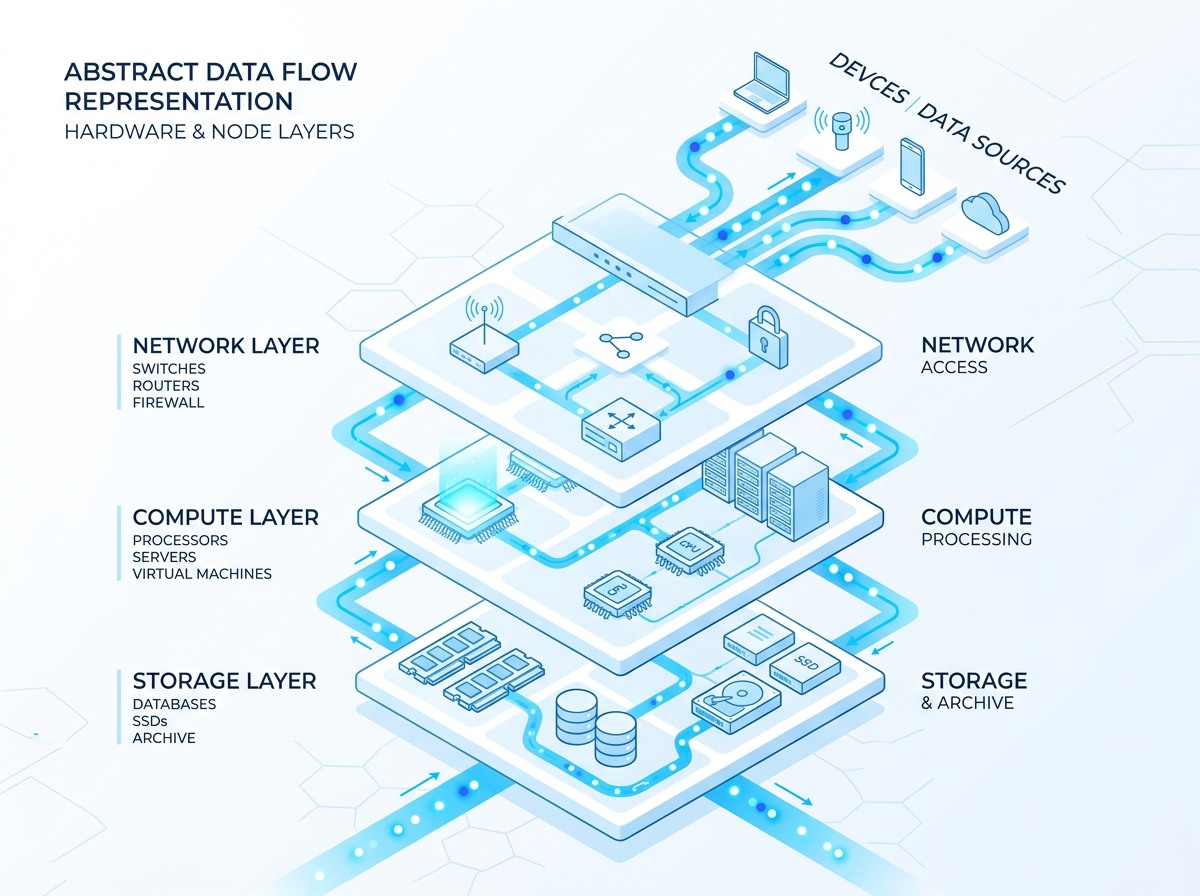

대부분의 기업은 특정 작업에 특화된 칩을 사용합니다. 하지만 AI 에이전트는 한 번의 작업에 여러 단계를 거치며, 각 단계마다 필요한 하드웨어 자원이 완전히 다릅니다.

- 추론 단계는 연산 능력이 중요합니다

- 데이터 디코딩은 메모리 대역폭이 필수입니다

- 툴 호출은 네트워크 응답 속도가 핵심입니다

단일 칩이 이 모든 부하를 처리하기에는 한계가 분명하며, 결과적으로 특정 하드웨어가 노는 시간이 발생하게 됩니다.

AI 인프라 자원 낭비를 줄이는 3가지 핵심

많은 기업이 현재 보유한 하드웨어를 15%에서 30% 정도만 제대로 활용하고 있습니다. 나머지 자원은 사실상 유휴 상태로 방치되어 막대한 비용 손실을 야기하는 셈입니다.

- 하드웨어 이기종 혼합 활용 전략 수립

- 특정 작업별 최적 칩 배분 자동화

- 소프트웨어 레이어를 통한 워크로드 분산

Gimlet Labs의 멀티 실리콘 클라우드 방식

최근 8천만 달러의 투자를 유치한 Gimlet Labs는 소프트웨어로 이 문제를 접근합니다. 이들은 AI 워크로드를 여러 유형의 하드웨어에 동시에 분산시키는 방식을 택했습니다.

- 전통적인 CPU와 AI 특화 GPU를 결합

- 모델을 조각내어 아키텍처별로 최적화된 칩에 할당

- 실시간으로 가용한 자원을 찾아 워크로드 재배치

추론 성능을 3배 이상 높이는 최적화 원리

단순히 하드웨어를 많이 도입하는 것이 능사는 아닙니다. Gimlet Labs의 사례에서 볼 수 있듯이 기존 하드웨어를 어떻게 효율적으로 배치하느냐가 승부처입니다.

- 작업 성격에 맞는 칩 동시 연동

- 오케스트레이션 소프트웨어 도입을 통한 병목 제거

- 전력 소비와 비용 대비 효율 극대화

이러한 접근은 대형 모델을 운영하는 곳뿐만 아니라 중규모 데이터 센터를 운영하는 환경에서도 충분히 고려해볼 만한 가치가 있습니다.

어떻게 하면 10배 더 효율적인 시스템을 만들까

실제 운영 환경에서 비용 대비 성능을 10배 높이려면 단순히 하드웨어를 업그레이드하는 관점에서 벗어나야 합니다. 시스템 아키텍처의 유연성을 확보하는 것이 최우선입니다.

- 유휴 자원을 실시간으로 감지하고 즉시 투입

- AI 에이전트의 작업 단계를 세분화하여 병렬 처리

- 특정 벤더에 종속되지 않는 소프트웨어 호환성 확보

출처: https://techcrunch.com/2026/03/23/startup-gimlet-labs-is-solving-the-ai-inference-bottleneck-in-a-surprisingly-elegant-way/

마무리하며

AI 인프라의 병목 현상은 단순히 칩의 문제가 아니라 이를 관리하는 소프트웨어의 부재에서 시작됩니다. 보유한 자원을 어떻게 효율적으로 쪼개고 연결하느냐에 따라 향후 운영 비용은 크게 달라질 것입니다. 현재 자사 시스템의 병목 구간을 먼저 파악하고, 워크로드를 분산시킬 수 있는 오케스트레이션 도입을 고민해 보시기 바랍니다.

이어서 보면 좋은 글

#AI추론 #병목현상 #데이터센터 #컴퓨팅최적화 #GimletLabs #AI인프라 #서버비용절감 #클라우드컴퓨팅 #AI워크로드 #GPU최적화