딥러닝 모델이 왜 그런 답변을 내놓는지 정확히 이해하는 일은 인공지능 분야에서 가장 까다로운 숙제 중 하나였어요. 오픈AI나 xAI 같은 기업들도 모델의 환각 현상이나 편향성을 제어하는 데 애를 먹고 있죠. 최근 샌프란시스코의 스타트업 가이드 랩스(Guide Labs)가 공개한 새로운 모델은 인공지능의 내부 작동 원리를 투명하게 들여다볼 수 있는 실마리를 제시하고 있습니다.

왜 기존 AI 모델은 답변 근거를 알기 어려웠을까요

그동안 우리가 사용해온 거대언어모델은 수십억 개의 매개변수가 복잡하게 얽혀 있는 블랙박스와 같았습니다. 특정 질문에 대해 왜 그런 답변이 나왔는지 추적하는 작업은 마치 뇌 과학자가 뉴런의 움직임을 하나하나 분석하는 것만큼이나 어려운 일이었죠.

- 매개변수의 복잡성으로 인한 추적 불가능성

- 학습 데이터와 출력값 사이의 연결 고리 부재

- 모델의 판단 근거를 설명할 수 없는 기술적 한계

이런 불투명성은 금융이나 의료처럼 신뢰가 중요한 산업에서 AI 도입을 망설이게 만드는 결정적인 요인이 되었습니다. 답변의 출처를 모르니 결과물을 100% 믿기 어려웠던 것이 사실이었거든요.

Guide Labs 가해석성 AI 모델 Steerling-8B의 특징

가이드 랩스가 이번에 오픈소스로 공개한 Steerling-8B는 80억 개의 매개변수를 가진 모델입니다. 이 모델의 가장 큰 차별점은 가해석성(Interpretability)에 초점을 맞춰 설계되었다는 점이에요. 모델이 생성하는 모든 토큰의 기원을 학습 데이터에서 찾아낼 수 있습니다.

- 모든 출력 데이터의 기원 추적 가능

- 특정 개념에 대한 모델의 이해도 확인

- 유머나 젠더와 같은 복잡한 개념의 제어 용이

MIT 출신의 CEO 줄리어스 아데바요는 기존 모델들이 가진 취약성을 극복하기 위해 설계 단계부터 아키텍처를 완전히 뒤집었다고 설명했습니다. 뇌 과학을 하듯 사후에 분석하는 게 아니라 처음부터 이해 가능하도록 엔지니어링한 셈이죠.

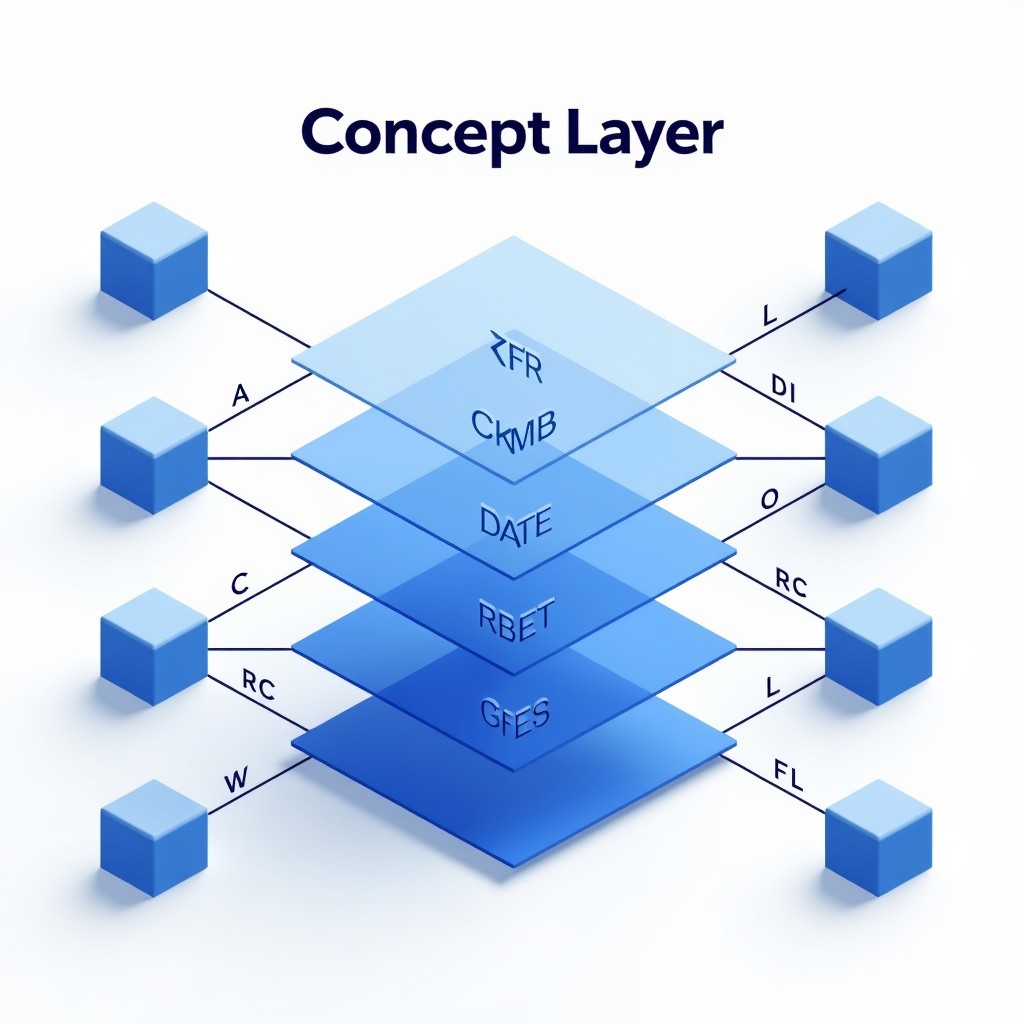

데이터 투명성을 확보하는 컨셉 레이어 설계 방법

가이드 랩스는 모델 내부에 컨셉 레이어(Concept Layer)라는 독특한 구조를 삽입했습니다. 데이터를 추적 가능한 카테고리로 분류하여 저장하는 방식인데 이 과정에서 다른 AI 모델을 활용해 데이터 주석 작업을 보조하기도 했더라고요.

- 학습 데이터를 구체적인 개념 단위로 버킷화하기

- 모델 내부에 독립적인 컨셉 레이어 삽입

- 출력 시점에 각 토큰이 어떤 개념에서 유도되었는지 연결

이런 방식은 데이터 라벨링에 더 많은 노력이 필요하지만 결과적으로 모델의 행동을 완벽하게 통제할 수 있게 해줍니다. 과거에는 우연히 발견되던 모델의 행동들이 이제는 설계자의 의도 아래 놓이게 된 것이죠.

금융과 과학 분야에서 LLM 투명성이 필요한 이유

가해석성이 확보된 AI 모델은 규제가 엄격한 산업군에서 특히 빛을 발할 것으로 보입니다. 예를 들어 대출 심사를 수행하는 AI가 인종이나 성별이 아닌 오직 금융 기록만을 토대로 판단했는지 증명해야 할 때 이 기술이 핵심적인 역할을 하게 됩니다.

- 금융권의 공정한 대출 및 신용 평가

- 과학 연구에서의 단백질 구조 분석 근거 확인

- 저작권이 있는 데이터의 사용 여부 필터링

- 폭력적이거나 유해한 출력물의 근거 차단

단백질 접힘 구조를 분석하는 과학자들도 AI가 왜 그런 조합을 제시했는지 논리적인 근거를 확인하고 싶어 합니다. 가이드 랩스의 기술은 인공지능이 제시하는 결과의 과학적 신뢰도를 한 단계 높여줄 수 있을 것으로 기대되더라고요.

Steerling-8B 모델이 증명한 인공지능 엔지니어링의 미래

기존에는 모델의 가해석성을 높이면 성능이 떨어질 것이라는 우려가 많았습니다. 하지만 가이드 랩스는 Steerling-8B가 기존 모델 성능의 90% 수준을 달성하면서도 더 적은 데이터로 효율적인 학습이 가능하다는 것을 보여주었습니다.

- 가해석성 확보와 성능 유지의 공존 가능성 입증

- 과학의 영역을 공학의 영역으로 전환

- 소규모 자본으로도 고성능 투명 모델 구축 가능

이들은 향후 더 큰 규모의 모델을 개발하고 API와 에이전트 서비스를 제공할 계획이라고 합니다. 인류가 통제할 수 없는 초지능이 등장하기 전에 우리가 이해할 수 있는 방식으로 AI를 길들이는 법을 찾아낸 셈이죠.

인공지능의 블랙박스를 여는 Guide Labs의 도전

Guide Labs가 보여준 행보는 단순히 성능 좋은 모델 하나를 추가한 것 이상의 의미를 가집니다. 인공지능이 내리는 수많은 결정이 더 이상 미스터리로 남지 않도록 기술적 토대를 마련했기 때문이죠. 우리가 매일 사용하는 기술의 속마음을 알 수 있게 된다는 것은 그만큼 안전한 미래를 설계할 수 있다는 뜻이기도 합니다. 앞으로 이들이 만들어갈 더 투명한 인공지능 생태계가 우리 삶을 어떻게 변화시킬지 계속해서 지켜봐야겠습니다.

출처: https://techcrunch.com/2026/02/23/guide-labs-debuts-a-new-kind-of-interpretable-llm/

이어서 보면 좋은 글

#GuideLabs #가해석성AI #Steerling8B #LLM투명성 #인공지능윤리 #AI신뢰성 #데이터주석 #오픈소스AI #딥러닝보안 #차세대LLM